Voitures autonomes et responsabilité(s) : « un enjeu primordial sous la conduite du législateur »

Par Pierre LEGROS

En mars 2018, une voiture autonome Uber a causé la mort d’une femme à Tempe – dans l’État d’Arizona –, qui traversait à pied une route non éclairée. Un an plus tard, la procureure du même État a déclaré qu’il n’y avait pas lieu d’engager la responsabilité pénale de la société Uber au regard de l’insuffisance des preuves obtenues à l’issue de l’enquête, et cela malgré un défaut d’avertissement avéré de la « conductrice » sur la nécessité d’activer manuellement le freinage d’urgence. Maintenant, il reste néanmoins à déterminer l’opportunité des poursuites pénales s’agissant de la responsabilité de la « conductrice de sécurité » ou « opératrice » qui, à charge contre elle, semble regarder une vidéo sur son smartphone au moment de la collision.

Cette actualité remet ainsi au goût du jour le questionnement juridique autour du régime de responsabilité civile et pénale que chaque législateur ou, à défaut, chaque juge aura demain à adapter dans son propre État, en cas d’accident impliquant une voiture autonome. Dans cette affaire, à la différence du dilemme du tramway 3.0 que pose le véhicule sans chauffeur dans une situation où un choix éthique serait à faire en cas de risques immédiats entre plusieurs groupes de personnes dont la vie est menacée, il n’est pas question de faire un choix entre la vie du conducteur ou la vie de la piétonne qui traversait la route. Tout le questionnement tourne ici autour de l’imputabilité de la faute commise et, de jure, de la responsabilité civile qui en découle.

Source : The Telegraph

Pour adapter le régime de responsabilité civile actuel en matière d’accident de la circulation au développement de la voiture intelligente, pléthore de régimes de responsabilité sont juridiquement envisageables tant pour les voitures autonomes d’aujourd’hui (niveau 3), que pour celles de demain (niveau 4 puis 5) et tant sur le plan national, que sur le plan international. Alors qu’une première solution résiderait dans une interprétation plus large de la notion de « conducteur », une seconde pourrait plutôt nous amener à envisager une responsabilité alternative ou partagée du fabricant et du « conducteur ». En outre, au-delà de ces deux régimes traditionnels, peut-être sera-t-il nécessaire d’innover complètement en développant, à terme, un régime de responsabilité tout aussi « autonome » et propre à la voiture intelligente elle-même.

Un ajustement possible de la notion juridique de « conducteur »

Dans la plupart des réglementations nationales et internationales, la notion de « conducteur » pose problème dans l’imputation de la responsabilité civile à la personne assise derrière le volant. En effet, que celle-ci soit considérée comme un opérateur d’une voiture en mode autonome (niveau 3 et 4), ou qu’elle ne soit qu’un simple passager lorsque la voiture est totalement autonome et ne dispose même plus de volant (niveau 5), la notion de maîtrise du véhicule nécessaire à l’imputation d’une responsabilité perd grandement de sa pertinence. Une des solutions possibles serait finalement de ne pas abroger le régime de responsabilité en vigueur, mais tout simplement de l’adapter par une interprétation extensive de la notion.

Le conducteur est donc traditionnellement défini comme celui ayant la maîtrise du véhicule. La Convention de Vienne sur la circulation routière du 8 novembre 1968, qui mentionne cette notion à pas moins de 154 reprises, la définit en son article 1.v) comme étant « toute personne qui assume la direction d’un véhicule, automobile ou autre […] ». Le conducteur est donc la personne qui exerce un pouvoir de direction sur le véhicule. Dès lors, une interprétation extrêmement large de la notion de « pouvoir de direction » pourrait potentiellement permettre de considérer la personne derrière le volant du véhicule en mode autonome (niveau 3 et 4), voire le passager de la voiture sans conducteur (niveau 5), comme étant juridiquement responsable des dommages causés par celle-ci.

Cette extension notionnelle ne serait que le prolongement de la pratique jurisprudentielle actuelle. En effet, lorsqu’un parent encadre son enfant en conduite accompagnée par exemple, il est tenu pour responsable des dommages causés par son enfant, en dépit du fait qu’il n’ait ni le volant en main, ni les pédales sous ses pieds. Cela se justifie par le fait qu’il est, d’une part, le propriétaire du véhicule et, d’autre part, seul détenteur du permis de conduire. De la même manière, lorsqu’un conducteur s’endort au volant et est donc dans un état psychique d’inconscience – incompatible avec la définition même du conducteur, puisqu’en s’endormant il perd la maîtrise du véhicule et son pouvoir de direction –, la responsabilité de ce dernier est pourtant retenue.

Ainsi, l’interprétation juridique du « conducteur » ne correspond pas nécessairement à la réalité physique ou psychique de la personne assise derrière le volant et contrôlant parfaitement la direction de son véhicule, au même titre que la filiation juridique ne représente pas toujours une réalité biologique. Dans les deux cas on peut parler de la construction d’une fiction juridique. Cela s’explique tout simplement par le fait que le régime de responsabilité en matière d’accident de la route a pour principal objectif l’indemnisation de la victime, en faisant jouer le système assurantiel obligatoire. Par ailleurs, il s’agit généralement d’un régime de responsabilité objectif, très favorable à la victime puisqu’il n’exige qu’une implication du véhicule, peu importe l’existence ou non d’une faute du conducteur.

Par conséquent, une des possibilités serait de poursuivre l’extension de l’interprétation de la notion de « conducteur » jusqu’à son paroxysme, pour l’adapter à la voiture autonome, en considérant un simple passager comme étant juridiquement le conducteur. Ce dernier, bien que n’ayant plus de volant entre ses mains, pourrait toujours contrôler la voiture au moins avec sa voix, par exemple en demandant à la voiture de changer de trajectoire, de se stationner le plus près possible, de s’arrêter en urgence etc., plutôt que d’aller jusqu’à la destination finale initialement ordonnée.

Si cette solution est juridiquement possible, il faut toutefois reconnaître que l’opinion publique y serait certainement défavorable, car, en tout état de cause, même si le simple passager de la voiture totalement autonome (niveau 5) gardera sur elle une forme de pouvoir de direction, principalement sur la destination choisie, celui-ci sera extrêmement affaibli. Il semblerait donc critiquable, sur le plan éthique, de considérer autant responsable un conducteur ayant causé, volontairement ou non, un accident de la circulation par son défaut de maîtrise du véhicule, qu’un simple passager de voiture autonome.

Par ailleurs, cette réponse ne saurait répondre à toutes les situations d’accidents : quid en cas de piratage de la voiture autonome, autrement dit en cas d’intrusion extérieure, imprévisible et irrésistible de son système ? Il semble que le passager ne puisse pas se voir imputer la faute, car il pourrait invoquer l’état de force majeure comme cause d’exonération de sa responsabilité. C’est pourquoi, à côté de cette première solution, il faudrait envisager la responsabilité partagée, voire exclusive, du fabricant (constructeur, équipementier et/ou fournisseur de logiciel).

Le partage, voire l’exclusivité de la responsabilité du fabricant (constructeur, équipementier ou fournisseur de logiciel)

Tout d’abord, il faut dire que la chaîne d’intervenants dans la confection du véhicule autonome (constructeur, équipementier, fournisseur de logiciel, etc.) complexifie considérablement l’expertise tendant à déterminer la responsabilité de chacun dans le cas où, par exemple, la boîte noire du véhicule reconnaîtrait une anomalie du programme ayant causé l’accident, tel qu’un défaut technique ou pire, un piratage. En effet, même dans le cas d’un accès frauduleux au système d’intelligence artificielle, si celui-ci avait pu être évité par une simple mise à jour du pare-feu, il faudrait alors pouvoir a minima envisager la responsabilité du fabricant qui ne l’a pas effectuée.

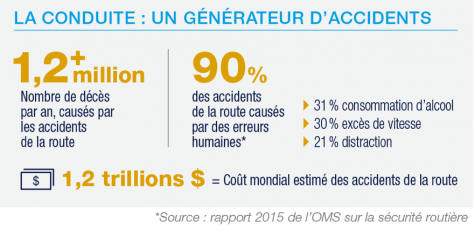

Certains constructeurs ont ainsi évoqué la possibilité d’assumer la responsabilité des accidents liés à leurs véhicules. C’est notamment le cas de la marque Volvo qui, ayant pour ambition d’atteindre un objectif de zéro mort ou blessé grave à bord de ses voitures à compter de 2020, promet de prendre en charge l’entière responsabilité en cas d’accident de conduite en mode autonome. Somme toute, le nombre d’accidents devant diminuer de 90% selon les estimations de l’Organisation Mondiale Santé (correspondant au pourcentage d’accidents liés à une erreur humaine), cela serait donc financièrement peu risqué pour un grand groupe tel que Volvo, ou même Google.

Néanmoins, il ne faudrait pas que cela conduise à placer une épée de Damoclès au-dessus de plus petits constructeurs ne disposant pas de la trésorerie des grands groupes. Témoignant de ces craintes, une étude réalisée par Rand Corp prévoie qu’une telle responsabilité sans faute des fabricants du fait de leurs produits défectueux s’étendrait probablement dans les années à venir, et que cela pourrait alors mettre un grand coup de frein à l’introduction de cette innovation sur le marché. De facto, les énormes enjeux économiques et industriels relatifs à l’introduction de la voiture autonome sont tels qu’ils viennent questionner la pertinence juridique d’une responsabilité exclusive des fabricants.

Il n’en demeure pas moins qu’une telle responsabilité existe pourtant déjà. En effet, aujourd’hui, si une expertise révèle que la cause de l’accident est d’ordre technique, alors le garagiste ou le constructeur peut ainsi voir sa responsabilité civile engagée a posteriori, par une action récursoire de l’assurance du conducteur qui aurait, entre temps, déjà indemnisé la victime.

Par ailleurs, étant donné que les constructeurs du secteur automobile se voient imposer de plus en plus de normes assez lourdes en matière de sécurité, il semblerait logique que cette responsabilité leur incombe. D’autant plus que, comme cela a été mentionné précédemment, les véhicules autonomes devraient réduire de 90% le nombre d’accidents, faisant ainsi disparaître des statistiques ceux causés par des erreurs humaines. Par conséquent, lorsque les véhicules seront totalement autonomes (niveau 5), les accidents seront, en principe, uniquement liés à des motifs techniques. On peut alors légitimement remettre en question la pertinence du maintien de la responsabilité du conducteur à ce stade.

Juridiquement, il serait tout à fait envisageable de faire de l’obligation de sécurité des fabricants non plus une obligation de moyen, mais bien une obligation de résultat. Cela permettrait à la victime d’engager une action directe auprès du constructeur en cas de dommage, charge à ce dernier de se retourner contre l’équipementier ou le fournisseur de logiciel le cas échéant. De plus, cela renforcerait la valeur des normes de sécurité et devrait faire assumer aux fabricants leur entière responsabilité et ainsi éviter un « Dieselgate » des voitures autonomes.

Cependant, même si demain le système de capteurs et l’expertise technique de la boîte noire pourraient aider à déterminer la part de responsabilité de chacun, une complexification des recours semble se dessiner. Ainsi, il reviendra à chaque législateur d’adopter la réglementation la plus adaptée – idéalement uniformisée – en la matière. Un tel choix dépendra nécessairement du contexte de l’accident, des dommages causés, mais également du niveau d’autonomie de la voiture, qui constitue un critère nouveau entrant dans le mécanisme de responsabilité. Néanmoins, à l’ère du développement des contrats intelligents et de l’intelligence artificielle, pourquoi ne pas envisager le fait que la voiture intelligente puisse être « auto-responsable » ?

Vers une responsabilité autonome de la voiture intelligente ?

Sur le plus long terme, on peut imaginer que les routes des pays développés ne seront plus occupées que par des véhicules totalement autonomes (navettes autonomes, robot-taxis autonomes, voitures autonomes en autopartage, etc.). La notion même de propriété individuelle telle qu’on la connait sera dès lors remise en question, faisant des propriétaires de voitures d’aujourd’hui, les simples usagers ou consommateurs de demain (normalement au bénéfice, entre autres, des questions écologiques). Ainsi, on peut légitimement remettre en question l’opportunité d’une interprétation extensive de la notion de « conducteur » au détriment du passager, telle qu’elle a été précédemment évoquée.

Aujourd’hui déjà, lorsqu’un transport en commun ou un taxi est concerné par un accident, le passager n’est pas juridiquement tenu pour responsable des dommages. Bien au contraire, il se trouve en position de victime directe et se voit indemnisé des préjudices subis. La responsabilité civile pèse donc sur le transporteur, que son fondement soit contractuel ou, à défaut, extracontractuel. Mais, si demain ces services de transports n’ont plus de chauffeur, qui sera alors considéré comme responsable ?

Une première approche pourrait conduire la victime à se retourner contre la personne morale proposant le service privé ou public. Néanmoins, dans le cas où, par exemple, le taxi ou la navette autonome ait été dévié de sa trajectoire et que le responsable reste inconnu, qui indemnisera les victimes ? Une alternative semble émerger autour de la notion de responsabilité autonome du véhicule intelligent.

Dans un monde où les animaux commencent à se voir reconnaître un statut juridique sui generis en France, en Belgique, au Canada, etc., pourquoi les robots de demain, dotés d’intelligence artificielle, n’auraient pas également le droit à un statut juridique particulier ? Selon Maître Alain Bensoussan, cette comparaison classique des robots avec les animaux domestiques serait à relativiser, car « contrairement aux animaux, les robots ne sont pas biologiquement vivants et ne sont pas doués de sensibilité. Surtout, ils sont dotés d’une intelligence que les animaux n’ont pas ». Néanmoins, ce dernier est favorable à l’acquisition d’un statut juridique autonome des robots leur conférant une personnalité juridique spécifique, considérant que « le robot doit être reconnaissable: il lui faut un numéro d’immatriculation, un nom et un capital, un peu comme pour une personne morale. Car si le robot cause un dommage, il faut prévoir les recours contre lui ».

Par ailleurs, en 2016, à la suite d’une requête de Google, la NHTSA[1] a rendu un avis dans lequel elle a admis que l’intelligence artificielle – pilotant la Google car autonome – puisse être considérée comme un conducteur à part entière. La question était de savoir si les voitures de Google pouvaient s’affranchir des Federal Motor Vehicle Safety Standards (FMVSS)[2], conçus en présumant la présence d’un humain derrière le volant, ou bien s’il fallait considérer le mode pilote automatique comme étant « le conducteur » ? Dans sa réponse, la NHTSA a choisi la seconde option puisqu’elle « interprètera le mot « conducteur », dans le contexte de description du projet de voiture, comme se référant au système de conduite autonome et pas à l’un des occupants du véhicule ». À partir de cela, si on considère la voiture autonome comme étant le conducteur, alors la voiture doit être juridiquement responsable.

Mais, une voiture peut-elle juridiquement être tenue comme responsable ? Cette interrogation ne peut trouver de réponse sans étudier préalablement la possibilité pour une voiture autonome d’acquérir une personnalité juridique. A ce propos, l’Union européenne semble aller dans le sens d’une réglementation sur la robotique et l’intelligence artificielle. Dans sa résolution EC/2015/2013 (INL) votée le 16 février 2017, le Parlement européen recommande de créer une « personnalité électronique » spécifique aux robots leur attribuant des droits et des obligations, qui s’appliquerait dans les cas où les robots « prennent des décisions » ou, plus largement, interagissent avec des tiers. Le fait même d’accorder la personnalité juridique aux robots intelligents, consacrant non seulement des obligations, mais surtout des droits, ferait d’eux des sujets actifs de droits, ayant par conséquent la capacité de mener une action civile et d’être tenu responsable de leurs actes.

Source : euro-assurance

Toutefois, une lettre ouverte initiée par Nathalie Nevejans[3] publiée en avril 2018, et signée à ce jour par 285 experts européens en robotique et en éthique de l’intelligence artificielle, a pour objet de dissuader la Commission européenne d’attribuer une responsabilité juridique aux robots. Un des arguments majeurs invoqués tient en ce qu’un statut juridique pour un robot ne peut pas s’inspirer du modèle de personne physique, pour la simple et bonne raison que le robot se verrait alors attribuer des Droits humains, tels que le droit de la dignité, le droit à l’intégrité, le droit de la rémunération ou le droit de la citoyenneté. Bien que paradoxal pour un juriste, ce scénario semble pourtant se confirmer dans les faits, par exemple avec le robot Sophia, qui a obtenu la citoyenneté saoudienne, questionnant ainsi directement l’essence même des Droits de l’ « Homme ».

Quoi qu’il en soit, admettre la responsabilité de la voiture autonome elle-même amènerait alors à repenser totalement le droit des assurances, mais également le droit de la responsabilité civile et pénale. En témoigne à ce titre, le procès fictif « Le carambolage du siècle » s’étant déroulé en octobre 2018 au sein de la Cour d’appel de Paris et qui traitait d’une affaire futuriste se déroulant en 2041. Les faits de l’espèce étaient les suivants : « un jour d’hiver où les routes étaient verglaçantes, voyant un véhicule arriver dans sa direction à toute vitesse, le passager d’une voiture autonome appuya sur le bouton rouge d’arrêt d’urgence. La réaction de la voiture intelligente déclencha une série de collisions, faisant 50 morts et 200 blessés. Qui est responsable ? »

Il convient de préciser que ce procès fictif partait du postulat selon lequel une loi avait déjà accordé une personnalité juridique aux objets dotés d’intelligence artificielle de type standard, et donc un patrimoine propre. Celui-ci a donc pu servir de fonds d’indemnisation et permettre ainsi l’indemnisation des victimes de l’accident sur le plan civil. Sur le plan pénal, l’intelligence artificielle « Eureka » chargée de conduire la voiture autonome a été condamnée à une peine de « redressement algorithmique », avec mise à l’épreuve en simulateur en vue d’obtenir une nouvelle autorisation de certification de permis.

En conséquence, les voitures autonomes sont en train de marquer un tournant, non seulement dans l’histoire de l’industrie automobile et des transports de façon générale, mais aussi a fortiori dans nos cadres légaux, voire même dans nos sociétés. Cependant, s’il y a aujourd’hui beaucoup de marketing et de communication autour de ces véhicules, en réalité ceux totalement autonomes (de niveaux 4 et 5) ne sont pas pour demain, tant au regard des techniques disponibles que de la législation. Actuellement, l’enjeu majeur consiste à passer du niveau 2 au niveau 3 et ce de façon globale, c’est-à-dire non pas seulement pour des véhicules haut de gamme. Néanmoins, les réflexions autour du régime de responsabilité qu’il faudra adopter demain ne sont pas superflues et doivent avoir lieu si le législateur veut éviter d’avoir, une fois de plus, un train de retard sur la technologie.

[1] National Highway Traffic Safety Administration (Autorité en charge de la sécurité routière aux États-Unis)

[2] Cadre réglementaire qui définit les caractéristiques d’une voiture et recense toutes les obligations techniques auxquelles les constructeurs automobiles doivent se conformer

[3] Professeure de Droit à la Faculté de Douai, membre du comité d’éthique du CNRS (COMETS) et auteure du premier Traité de droit et d’éthique de la robotique civile

Ce contenu a été mis à jour le 30 avril 2019 à 15 h 28 min.